通过分析日志文件来解锁强大的 SEO 和性能洞察。本指南展示如何发现抓取预算浪费、修复错误并提升排名。

December 24, 2025 (3mo ago)

用于 SEO 的日志文件分析实用指南

通过分析日志文件来解锁强大的 SEO 和性能洞察。本指南展示如何发现抓取预算浪费、修复错误并提升排名。

← Back to blog

用于 SEO 的日志文件分析实用指南

摘要: 通过分析日志文件来解锁强大的 SEO 和性能洞察。本指南展示如何发现抓取预算浪费、修复错误并提升排名。

介绍

说实话:大多数人把日志文件当成一堆技术乱码,最好交给 IT 团队处理。但这些文件包含了关于你网站健康状况以及搜索引擎如何真实看待它的真实数据。与经过润色的分析报告不同,服务器日志提供了对服务器的每一次请求的原始、未过滤记录——包括来自 Googlebot 等爬虫的访问。利用它们,你就能从猜测转向确定。

为什么日志文件分析是你的 SEO 秘密武器

像 Google Analytics 这样的工具展示用户在访问你的网站后的行为。日志文件则展示搜索引擎首先如何发现和评估你的网站。这一差异至关重要:如果爬虫无法找到或高效地抓取你关键页面,你的目标受众永远无法看到它们。通过深入挖掘日志,你在查看许多竞争对手忽视的数据。

揭示幕后真正发生的事情

日志分析用时间戳和事实替代假设。你不再只是想知道 Google 是否抓取了你的新文章,而是可以看到确切的访问时间和频率。这样的直接洞察让你在问题严重影响排名之前发现它们,并找到隐藏在显眼位置的优化机会。

以下是你可以期待的一些结果:

- 精确定位抓取预算浪费:爬虫是否把时间花在低价值的 URL、参数繁多的页面或阻止它们到达重要内容的重定向链上?

- 发现“隐形”错误:挖掘用户从未报告但损害 SEO 和用户体验的 4xx 与 5xx 服务器错误。

- 验证技术性 SEO 修复:确认迁移、站点地图更改或 robots 更新是否生效。

- 理解爬虫行为:查看哪些站点部分被更频繁抓取——这是搜索引擎认为重要内容的线索。

日志文件是对现实的客观记录:不是抽样,而是服务器处理的每一次请求的完整故事。它为你建立更智能的 SEO 策略提供了无可争辩的证据。

从日志中可以发现的关键洞察

| 数据类型 | 潜在洞察与业务价值 |

|---|---|

| 抓取频率 | 发现爬虫认为重要的页面。关键页面的高抓取率是好事;低价值页面的高抓取率意味着抓取预算被浪费。 |

| 状态码 | 识别关键问题,如 404(未找到)或 503(服务不可用)错误,这些会阻碍索引并损害用户体验。 |

| 爬虫识别 | 验证你是否被合法爬虫(如 Googlebot)抓取,而非刮取器或恶意代理。 |

| 抓取延迟 | 精准定位加载缓慢的页面,这会令用户和爬虫感到沮丧,并可能导致排名下降。 |

| URL 发现 | 查看爬虫确切发现并抓取了哪些 URL,包括你以为已消失的旧重定向或页面。 |

这种直接可见性为你提供了 SEO 表现背后技术基础的清晰视图。

这一点正在变得越来越重要:全球日志管理市场预计在未来几年显著增长1,使日志分析成为一种战略能力,而不仅仅是小众任务。

整合分散的日志数据

第一步:找到你的日志。在真实环境中它们很少集中在一个整洁的文件夹里——它们分布在 Web 服务器、应用实例、CDN、防火墙和云服务中。逐个服务器分析它们会让你无法发现全站范围的趋势。绝对的第一步是将这些数据集中到一个位置。

这会把分散的文本文件变成唯一可信来源。从那里你可以发现抓取异常并推动真正的 SEO 增长。

查找核心日志文件

常见来源包括:

- Nginx:通常位于 /var/log/nginx/access.log 和 /var/log/nginx/error.log

- Apache:常见于 /var/log/apache2/(Debian)或 /var/log/httpd/(Red Hat)

现代技术栈还会添加 CDN、WAF、负载均衡器和应用日志。每个源可能有不同的格式和位置,这正是集中式日志不可妥协的原因。

为清晰和能力而集中化

集中式日志使用轻量级的发送器或代理(例如 Filebeat)将日志行转发到中央存储和分析系统。像 ELK Stack 这样的开源选项在自托管方面很受欢迎,许多云服务也提供托管替代品。集中化让你可以在整个基础设施上运行查询,并追踪从 CDN 到应用服务器的完整请求旅程。2

这种统一视图对于发现问题来说是改变游戏规则的一步。跨多个服务器的 404 突增指向全站部署问题——这是仅检查孤立文件时会错过的事情。

克服现实世界的收集挑战

常见难题:

- 不同来源的格式不匹配

- 高数据量(日增长以 GB 或 TB 计)

- 日志内容中的安全和隐私问题

不要只是收集原始文件;构建一个用于收集、处理和保护日志的数据管道,使数据变得可靠且可用。

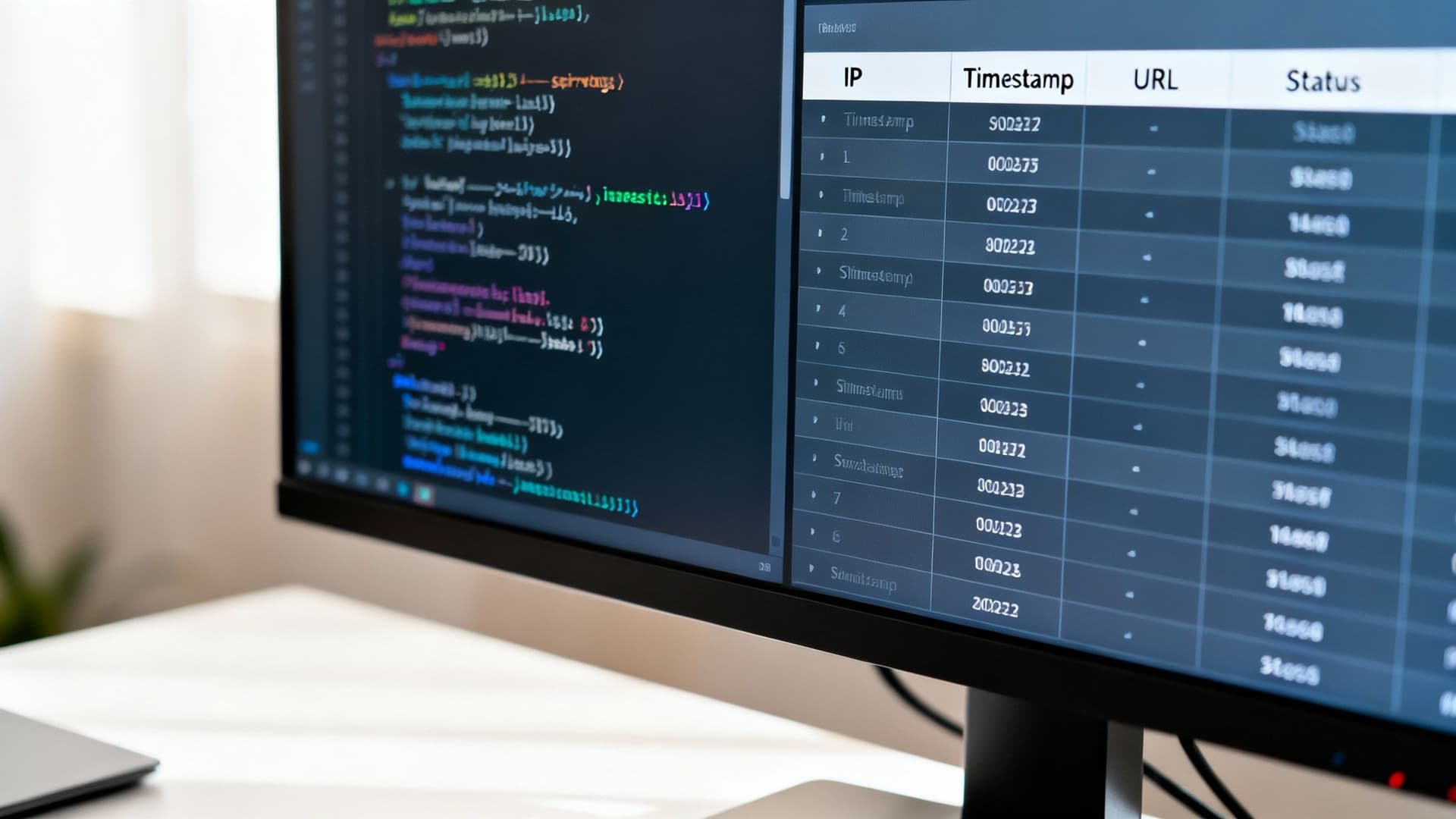

将原始日志转为结构化洞察

在所有日志集中后,下一步是解析:将原始行转换为命名字段,如 ip、timestamp、request_url、status_code 和 user_agent。解析把噪声变成可查询的信号。

解析的威力

一旦解析,你就可以筛选例如 user_agent = “Googlebot” 或 request_url 包含 “/products/” 的记录。解析使营销和工程团队实际使用的仪表板、图表和报告成为可能。

使用正则表达式分解日志

正则表达式是解析的常用工具。例如,一个 Nginx 条目像:

192.168.1.1 - - [10/Oct/2023:13:55:36 +0000] "GET /products/widget HTTP/1.1" 200 1234 "https://example.com/" "Mozilla/5.0..."

可以被解析为 IP、时间戳、请求、状态、字节、来源和用户代理。许多平台提供可重用的模式(例如 Grok),以加速此过程并避免重复造轮子。

使用工具和模式自动化解析

现代日志平台包含常见格式的预构建模式,减轻了大量正则负担。一旦结构化,你的日志就变成了可查询的数据集,可用于流程挖掘、抓取分析、性能排查等。

发现可执行的 SEO 与性能洞察

在集中且结构化的日志下,你可以从技术设置转向真实答案。日志是爬虫和用户如何与网站互动的终极真实来源。

揭示抓取预算浪费

抓取预算是有限的。如果爬虫把请求花在低价值页面上,你的重要页面就会受损。使用日志来回答:

- 哪些 URL 被 Googlebot 最频繁抓取?

- 爬虫遇到了多少 404?

- 爬虫是否被困在重定向链中?

修复浪费模式可以改善盈利页面的索引并推动自然流量。

精确定位性能瓶颈

日志通过 time-taken 字段或类似字段揭示慢速端点。筛选高延迟请求以查找缓慢页面或 API 调用。如果结账步骤缓慢,那对工程而言就是优先级。持续的慢响应强烈暗示你可能需要基础设施升级;日志证据有助于为投资建立商业理由。

验证你的技术性 SEO 努力

在 robots.txt 更改、站点地图更新或迁移后,在日志中确认结果。爬虫是否停止请求被禁止的 URL?新的站点部分是否被访问?这个反馈循环把假设变成事实。

企业对日志分析工具的采纳率很高——像 Splunk 和 Elastic 这样的平台主导市场,因为日志对运维、安全和性能至关重要34。

超越手动分析:仪表板与告警

手动检查日志是被动且缓慢的。构建仪表板和告警,让问题实时浮现,团队在客户察觉之前就采取行动。

构建早期预警仪表板

从几个关键可视化开始:

- 状态码趋势(随时间的 2xx、3xx、4xx、5xx)

- Googlebot 抓取活动(每小时/每天请求数)

- 响应最慢的页面(按平均响应时间排名前 10)

仪表板让你不用去搜寻异常;数据会自动显现它们。

设置主动告警

创建告警规则,当关键指标越过阈值时通知团队。示例:

- IF 500-level errors > 50 in 5 minutes, THEN post to #dev-alerts

- IF Googlebot requests drop by 80% day-over-day, THEN notify SEO

告警让你能在几分钟内响应,而不是几小时或几天,从而节省时间并降低对客户的影响。

在大规模下管理日志成本和性能

高流量会将日志量从兆字节变成太字节。如果你对所有内容都建立索引,存储和处理成本会激增。更聪明的采集策略可以在不丢失关键洞察的前提下控制成本。

降低日志量的智能策略

- 在发送器端过滤掉噪声、低价值条目(例如重复的 CDN 健康检查)

- 对非关键日志进行抽样(保留调试/信息事件的代表性子集)

- 强制执行数据保留分层:将热数据(可搜索)保留 30 天;将较旧数据转移到冷存储

这些方法在保留实际分析所需数据的同时降低成本。

量化日志减少的影响

对数据减少带来的节省进行建模以建立商业理由。即使是对索引量削减 20%,也能带来显著的月度节省。随着时间追踪这些节省以证明长期投资回报。

回答常见的日志文件分析问题

我应该保留多少日志数据?

目标是将日志在快速、可搜索的存储中至少保留 30 天以便即时调试。将更旧的日志归档到冷存储以供趋势分析或合规使用。

实时分析是否总是必要的?

不一定。实时对于运维紧急情况和安全非常重要。对于像抓取行为这样的 SEO 洞察,每日或每周检查通常就足够了。

日志分析能为我的企业省钱吗?

能。更好的抓取预算利用和更快的网站性能都会提高自然流量和转化率。减少不必要的日志量也能降低存储和处理成本。

准备把洞察转化为行动了吗?使用正确的数据和工具量化技术改进的影响,并用证据建立清晰的商业理由。例如,你可以使用诸如 Business Valuation Estimator 的工具对财务影响建模。

快速问答 — 常见问题与简短回答

问:我能从服务器日志中准确学到什么? 答:你会看到对你网站的每一次请求——爬虫抓取了哪些 URL、返回了哪些状态码、响应时间以及哪些代理在访问你的页面。

问:我多久能看到收益? 答:有些改进(比如修复重定向链或移除抓取路径中的低价值 URL)可以在几天内改善索引。性能修复和基础设施更改可能需要更长时间,但具有可衡量的投资回报。

问:我需要复杂的工具才能开始吗? 答:不需要。你可以从集中日志并解析几个核心字段开始。仪表板和基础告警能带来巨大的即时价值;随着需求增长再扩展工具。

准备构建您自己的工具了吗?

加入数百家已经使用自定义估算工具来增加利润和赢得更多客户的企业