Botları kontrol etmek ve teknik SEO'yu güçlendirmek için robots.txt dosyası oluşturmayı pratik, uygulamalı bir rehberle öğrenin.

January 11, 2026 (4mo ago)

SEO'yi Ustalayın: bu hızlı kılavuzla robots.txt dosyası oluşturun

Botları kontrol etmek ve teknik SEO'yu güçlendirmek için robots.txt dosyası oluşturmayı pratik, uygulamalı bir rehberle öğrenin.

← Back to blog

Generate robots.txt: Quick SEO Guide

Özet: Arama motorlarının ve botların davranışını kontrol etmek, değerli içeriği korumak ve tarama bütçesini optimize etmek için robots.txt dosyası oluşturma ve dağıtma adımlarını pratik örneklerle öğrenin.

Giriş

İyi hazırlanmış bir robots.txt dosyası, hangi tarayıcıların sitenize erişebileceği üzerinde kontrol sağlar, değerli içeriği korur ve tarama bütçesini önemli sayfalara odaklar. Bu rehber, arama motorlarının ve nazik botların sizin istediğiniz şekilde davranmasını sağlamak için robots.txt oluşturma, test etme ve güncelleme konusunda net, pratik adımlar gösterir.

Başlamak için

robots.txt adında düz bir metin dosyası oluşturun, User-agent: ve Disallow: gibi yönergeler ekleyin ve bunu sitenizin kök dizinine https://yourdomain.com/robots.txt olarak yükleyin. Tek bir dosya, arama motoru tarayıcıları ve diğer botlar için basit bir talimat seti işlevi görür.

Neden robots.txt dosyanız kritik bir SEO aracıdır

robots.txt ile oynamak teknik gelebilir, ama bu dosya sitenizin bekçisidir. Doğru kullanıldığında sunucu kaynaklarını korur ve tarayıcıları yüksek değerli sayfalara yönlendirir—bu da indeksleme ve sıralamayı iyileştirir. Robots Exclusion Protocol erken web dönemine dayanır ve rolü site altyapısının kilit bir parçası haline gelmiştir.1

Odaklanmış bir robots.txt, tarayıcıları trafik, potansiyel müşteri ve gelir getiren sayfalara yönlendirmenize yardımcı olurken yönetim sayfaları, dahili arama sonuçları ve yazdırma dostu yinelemeler gibi tarama bütçesini boşa harcayan alanlardan uzak tutar.

Bir robots.txt dosyası sadece bir hariç bırakma listesi değildir; arama motorları için stratejik bir rehberdir. Sitenizde sınırlı zamanlarını nerede harcayacaklarını söyler ve bu doğrudan hangi sayfaların indekslendiğini ve sıralandığını etkiler.

Sonuç olarak, robots.txt'i doğru ayarlamak daha iyi SEO performansı, korunan sunucu kaynakları ve en değerli içeriğinizin daha net keşfini sağlar.

Web tarayıcılarının dilini anlamak

Robots.txt, tarayıcılarla kısa bir konuşmadır. Dosya, hangi kapıların açık veya kapalı olduğunu göstermek için basit yönergeler kullanır. Bu komutlar basittir ve sağlıklı bir teknik SEO stratejisinin temelini oluşturur.

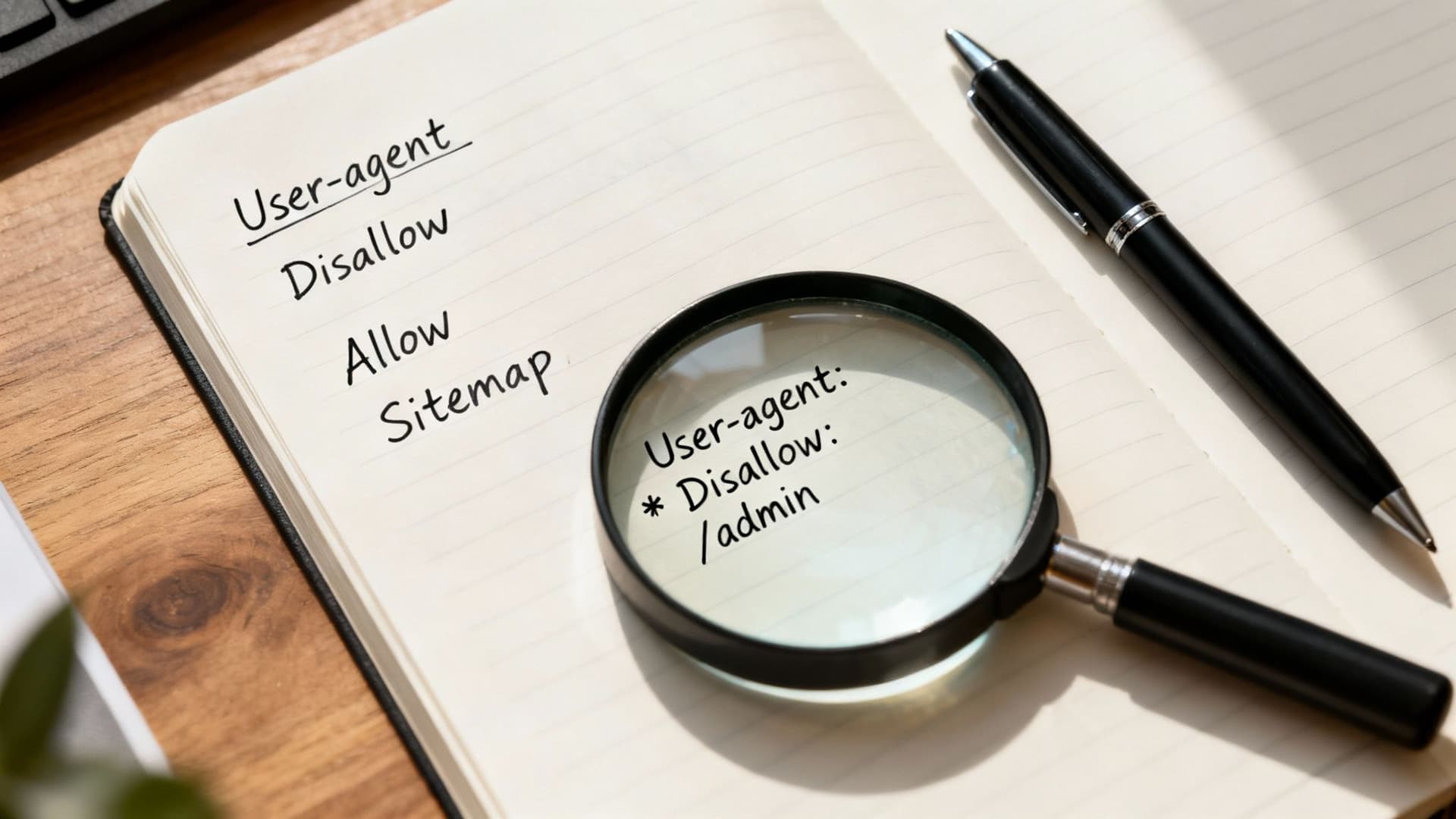

Temel robots.txt yönergeleri açıklaması

| Directive | What it does | When to use it |

|---|---|---|

| User-agent | Specifies which crawler the rules apply to. * is a wildcard for all bots. | Use User-agent: * for general rules, or specify Googlebot or Bingbot for targeted instructions. |

| Disallow | Tells bots not to crawl a specific file or directory. | Block admin login pages (/wp-admin/), internal search results, or unhelpful thank-you pages. |

| Allow | Overrides a Disallow for a specific subfolder or file. | Allow a single file inside a disallowed directory. |

| Sitemap | Points crawlers to your sitemap XML file so they can discover important pages. | Always include this to speed discovery of pages you want indexed. |

Bu basit komutlar tarayıcı davranışı üzerinde güçlü bir kontrol sağlar. Onları ustaca kullanmak etkili bir robots.txt dosyası oluşturmanıza yardımcı olur.

Yönergeleri uygulamaya koymak

Önemli bir etkileşimli aracınız varsa—örneğin, lead toplayan bir hesaplayıcı—arama motorlarının onu tarayıp indekslemesini istersiniz. Aynı zamanda SEO değeri eklemeyen sayfaları engellemek istersiniz. Yaygın, pratik bir robots.txt şu şekilde görünür:

User-agent: *

Disallow: /wp-admin/

Disallow: /private-files/

Disallow: /cgi-bin/

Sitemap: https://yourdomain.com/sitemap.xml

Bu yapı User-agent: * ile tüm botlara hitap eder, birkaç yaygın özel olmayan klasörü engeller ve tarayıcıları sitemap'e yönlendirir. Temiz ve etkilidir.

Tarayıcıların nasıl davrandığını daha iyi öğrenmek için sunucu günlüklerini ve ziyaretçi verilerini analiz edin. Hangi botların sitenize geldiğini anladıktan sonra, iş hedeflerinizi destekleyen kurallar oluşturabilirsiniz.

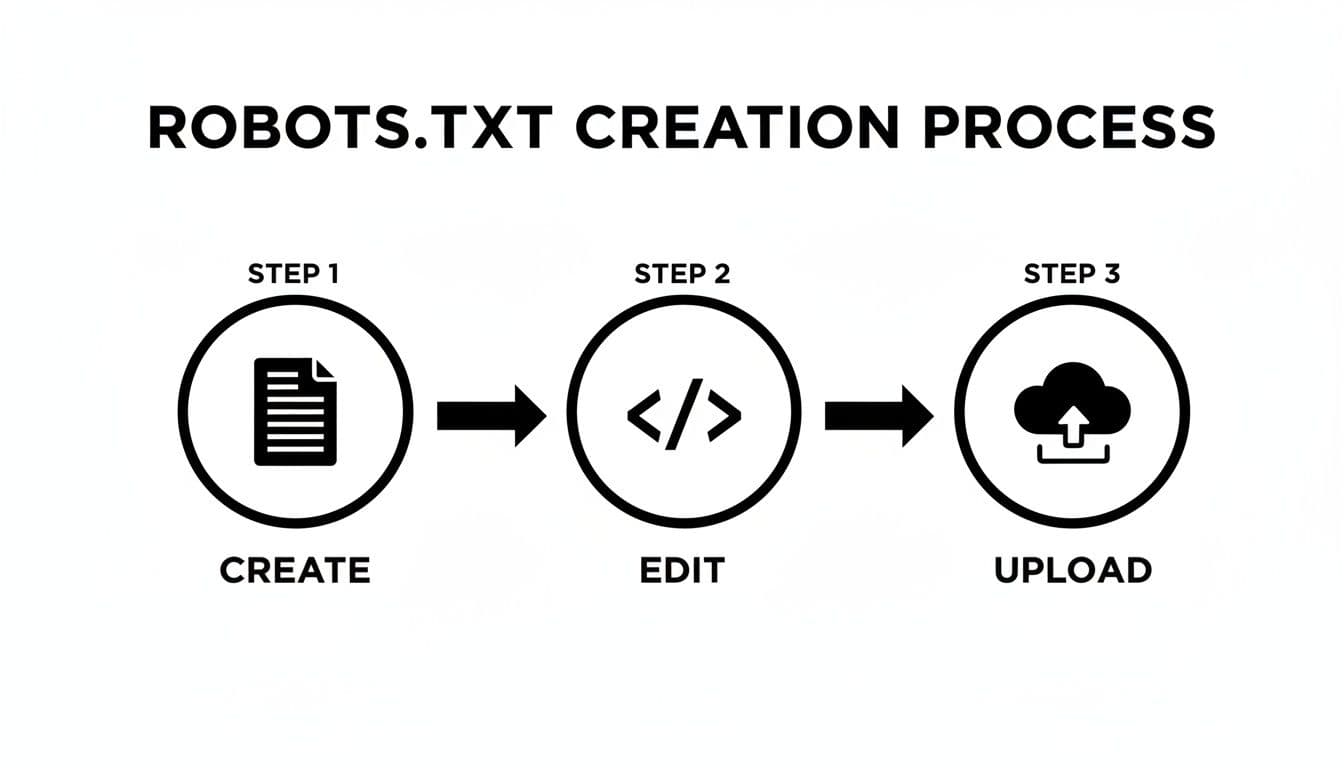

Robots.txt dosyanızı manuel olarak oluşturmak için pratik rehber

Bazen dosyayı elle oluşturmalısınız. Notepad veya TextEdit kullanın, dosyayı küçük harflerle robots.txt adıyla düz metin olarak kaydedin ve FTP veya barındırma dosya yöneticiniz aracılığıyla site köküne yükleyin. Dosyayı .docx veya .rtf olarak kaydederseniz, tarayıcılar onu göz ardı eder.

https://yourdomain.com/robots.txt konumuna yerleştirin. /blog/robots.txt gibi bir alt klasöre yüklemek, onu tarayıcılar için görünmez yapar.

Gerçek dünya iş hedefleri için kurallar oluşturma

Örnek: lead üreten bir Mortgage Hesaplayıcısı olan bir finans hizmetleri sitesi. Bu aracın indekslenmesini istersiniz, ancak yönetici alanlarının veya teşekkür sayfalarının arama sonuçlarında görünmesini istemezsiniz. Kurallarınızı şu şekilde ayarlayın:

User-agent: *

Allow: /

Disallow: /admin/

Disallow: /thank-you-for-your-submission/

Sitemap: https://www.yourfinancialsite.com/sitemap.xml

Bu, tüm tarayıcılara /admin/ ve teşekkür sayfası hariç sitede tarama izni verir ve onları bir sitemap'e yönlendirir. Derin veya önemli sayfaların daha hızlı bulunmasını sağlamak için böyle bir sitemap satırı ekleyin.

Not: Daha karmaşık dosyalarda sıra önemlidir. Çakışan

AllowveDisallowkuralları için, Googlebot'ta en özel kuralın önce gelmesi gerekir, aksi takdirde içeriği istemeden engelleyebilirsiniz.

Robots.txt oluşturma ve test etme, her teknik SEO denetiminin temel bir adımıdır.

Yeni nesil AI ve LLM tarayıcılarını yönetmek

Tarayıcı ortamı artık GPTBot ve Common Crawl gibi AI-özel botları içeriyor. Bu tarayıcılar hızla arttı ve birçok site onlara yönelik kuralları ayarlıyor. Nazik AI tarayıcıları robots.txt'e uyacaktır, ancak kötü amaçlı kazıyıcılar uymayabilir.2

Neden AI tarayıcıları engelleyebilirsiniz

AI tarayıcılarını engellemek, özgün içeriğinizin kazınmasını ve model eğitimi için atıf veya ödeme olmadan kullanılmasını önleyebilir. Eşsiz bir çevrimiçi araç oluşturduysanız, mantığını veya verilerini üçüncü tarafların toplamasını istemeyebilirsiniz. İçeriğinizin AI odaklı platformlarda görünürlüğünü elde etmenin faydalarını, içeriğinizin yeniden kullanılma riskiyle dengeleyin.

Günlük dosyalarını analiz etmek, hangi botların sitenizi ziyaret ettiğini görmenize yardımcı olur ve onları engelleyip engellememeniz gerektiği konusunda bilgi verir.3

Yaygın AI botlarını nasıl engellersiniz

Engellemek istediğiniz her tarayıcı için özel User-agent satırları ekleyin. Örnekler arasında GPTBot, CCBot, Google-Extended ve Anthropic-AI bulunur. Bir botu tamamen engellemek için:

User-agent: GPTBot

Disallow: /

User-agent: CCBot

Disallow: /

User-agent: Google-Extended

Disallow: /

Unutmayın, robots.txt bir onur sistemidir. Güvenilir tarayıcılar kurallarınıza uyacaktır, ancak kötü niyetli aktörler bunları görmezden gelebilir. Daha güçlü koruma için bir Web Uygulama Güvenlik Duvarı (WAF) veya özel bir bot yönetimi çözümü düşünün.

Yaygın ve maliyetli robots.txt hatalarından kaçınma

Tek bir yanlış yerleştirilmiş satır tüm sitenizin dizinden kaldırılmasına neden olabilir. Klasik hata Disallow: /'dur; bu, tüm tarayıcılara hiçbir sayfayı taramamaları talimatını verir. Siteniz aniden arama sonuçlarından kaybolursa, önce robots.txt'i kontrol edin.

Temel dosyaları engelleme

CSS veya JavaScript'i engellemek Google'ın sayfaları doğru şekilde render etmesini engelleyebilir; bu da SEO'ya zarar verir. Örneğin, siteniz önemli içeriği yüklemek için JavaScript'e dayanıyorsa /assets/js/'i engellemeyin. Bunun yerine gerektiğinde bu kaynaklar için Allow: kullanın:

- Önce (yanlış):

Disallow: /assets/js/ - Sonra (doğru):

Allow: /assets/js/

Çelişen kurallar ve sözdizimi hataları

Kurallar yukarıdan aşağıye okunur ve daha spesifik kurallar daha geniş olanlardan önce gelmelidir. /private/ klasörünü engellemek ama içindeki tek bir PDF'e izin vermek istiyorsanız, Googlebot için Allow kuralını önce koyun:

Allow: /private/public-report.pdf

Disallow: /private/

Ayrıca yazım hatalarına dikkat edin. "dissallow" gibi yanlış yazılmış bir yönerge göz ardı edilir. Değişiklikleri dağıtmadan önce Google Search Console’un robots.txt Test aracını kullanın.

Unutmayın, robots.txt nazik bir istektir, garanti değil. Birçok büyük yayıncı AI eğitim botlarını engelliyor, ancak kararlı kazıyıcılar dosyanızı tamamen görmezden gelebilir.4

Robots.txt dosyaları hakkında sık sorulan sorular

Robots.txt vs. noindex: fark nedir?

Robots.txt taramayı durdurur, noindex etiketi ise dizine eklenmeyi durdurur. Yönetim sayfaları gibi bölümlere tarayıcıların gitmesini engellemek için robots.txt kullanın; geçici açılış sayfaları gibi taranmasını ama arama sonuçlarında gösterilmemesini istediğiniz sayfalarda noindex kullanın.

Sitemap'imi robots.txt dosyama eklemeli miyim?

Evet. Sitemap: https://www.yourdomain.com/sitemap.xml eklemek, tarayıcıların derin bağlantılı, yüksek değerli içeriği daha hızlı keşfetmesine ve indekslemesine yardımcı olur. Birden çok sitemap kullanıyorsanız, her dosya için bir Sitemap: satırı ekleyin.

Robots.txt kötü botları ve kazıyıcıları durdurabilir mi?

Robots.txt yardımcı olur ama kusursuz değildir. İyi davranan tarayıcılara karşı etkilidir, ancak kötü niyetli kazıyıcılar genellikle onu görmezden gelir. Sağlam koruma için robots.txt'i sunucu düzeyinde kontroller, bir WAF ve bot yönetimi araçlarıyla birleştirin.

Sitenizin etkileşimini ve SEO'sunu etkileşimli araçlarla artırmaya hazır mısınız? MicroEstimates ile sitenize özel hesaplayıcılar oluşturup gömebilirsiniz. Lead üretimi ve kullanıcı etkileşimini desteklemek için bu araçları deneyin:

Hızlı Soru-Cevap — okuyucuların yaygın soruları

Çoğu site için en basit robots.txt hangisidir?

Başlangıç olarak:

User-agent: *

Disallow: /wp-admin/

Sitemap: https://yourdomain.com/sitemap.xml

GPTBot veya diğer AI tarayıcılarını nasıl engellerim?

Her tarayıcı için bir User-agent yönergesi ekleyin ve altında Disallow: / ayarlayın.

Robots.txt'i dağıtmadan önce nasıl test ederim?

Google Search Console’un robots.txt Test aracını kullanın ve beklenen davranışı doğrulamak için sunucu günlüklerini kontrol edin.

Kendi Araçlarınızı Ücretsiz Oluşturmaya Hazır mısınız?

Karları artırmak ve daha fazla müşteri kazanmak için özel tahmin araçlarını kullanan yüzlerce işletmeye katılın