Aprende a generar el archivo robots.txt para controlar rastreadores y mejorar el SEO técnico con una guía práctica.

January 11, 2026 (2mo ago)

Domina el SEO: genera el archivo robots.txt con esta guía rápida

Aprende a generar el archivo robots.txt para controlar rastreadores y mejorar el SEO técnico con una guía práctica.

← Back to blog

Generar robots.txt: Guía rápida de SEO

Resumen: Aprende a crear y desplegar un archivo robots.txt para controlar rastreadores, proteger contenido y optimizar el presupuesto de rastreo con ejemplos prácticos.

Introducción

Un archivo robots.txt bien elaborado te da control sobre qué rastreadores pueden acceder a tu sitio, ayuda a proteger contenido valioso y enfoca el presupuesto de rastreo en las páginas que importan. Esta guía muestra pasos claros y prácticos para crear, probar y actualizar tu robots.txt para que los motores de búsqueda y los bots educados se comporten como quieres.

Para comenzar

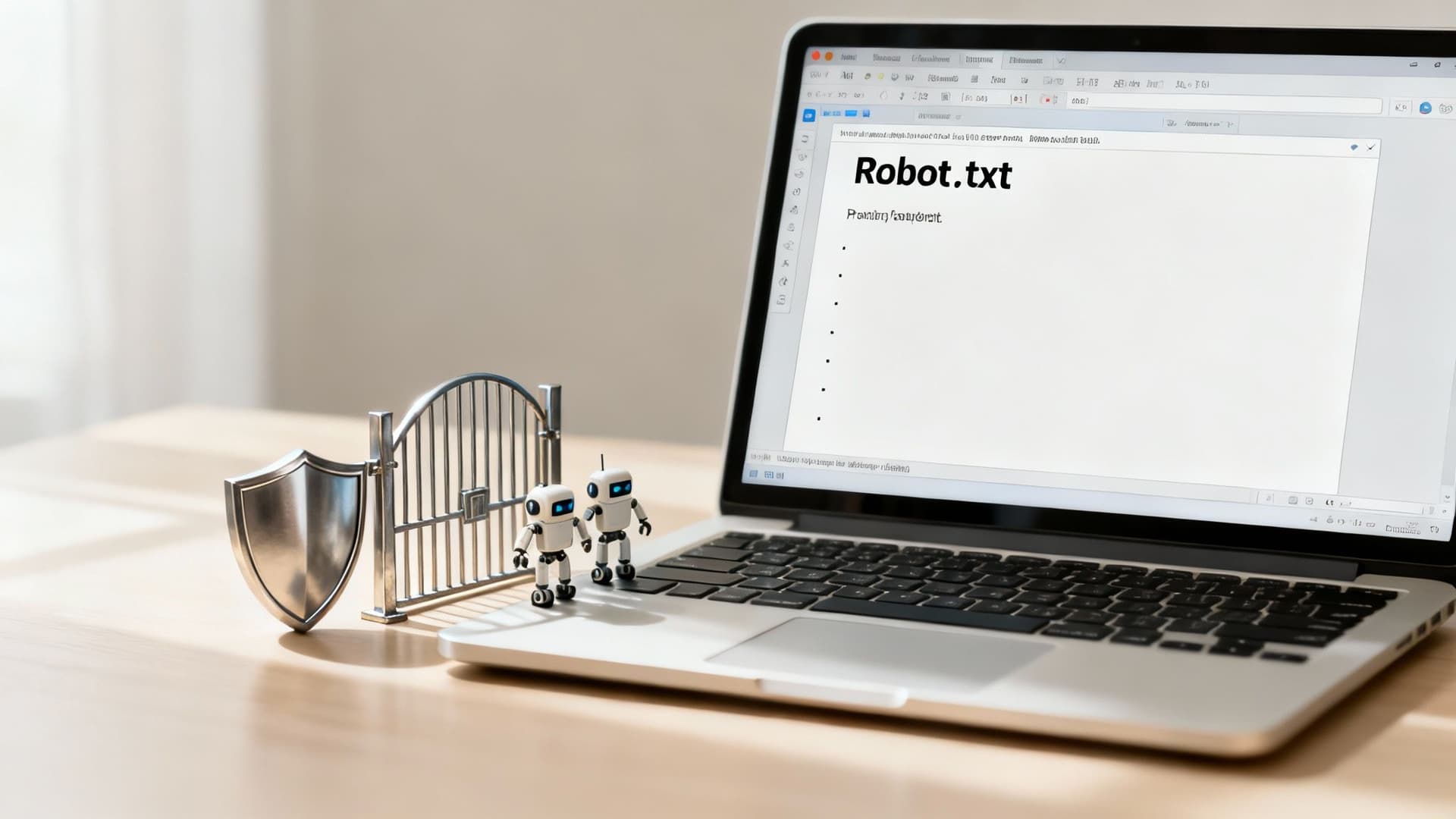

Crea un archivo de texto plano llamado robots.txt, añade directivas como User-agent: y Disallow:, y súbelo a la raíz de tu sitio en https://yourdomain.com/robots.txt. Ese único archivo actúa como un conjunto simple de instrucciones para los rastreadores de motores de búsqueda y otros bots.

Por qué tu archivo robots.txt es una herramienta crítica de SEO

Meterse con robots.txt puede sentirse técnico, pero es el guardián de tu sitio web. Usado correctamente, preserva recursos del servidor y dirige a los rastreadores hacia las páginas de alto valor—mejorando la indexación y el posicionamiento. El Protocolo de Exclusión de Robots se remonta a los primeros días de la web, y su papel ha evolucionado hasta convertirse en una pieza clave de la infraestructura del sitio.1

Un robots.txt enfocado te ayuda a dirigir a los rastreadores hacia las páginas que generan tráfico, leads e ingresos, mientras los mantienes alejados de áreas que desperdician presupuesto de rastreo, como páginas de administración, resultados de búsqueda internos y versiones imprimibles duplicadas.

Un archivo robots.txt es más que una lista de exclusión; es una guía estratégica para los motores de búsqueda. Les indica dónde gastar su tiempo limitado en tu sitio, influyendo directamente en qué páginas se indexan y posicionan.

En última instancia, acertar con robots.txt significa mejor rendimiento SEO, recursos del servidor preservados y un descubrimiento más claro de tu contenido más valioso.

Entendiendo el lenguaje de los rastreadores web

Robots.txt es una breve conversación con los rastreadores. El archivo usa directivas simples para indicar qué puertas están abiertas o cerradas. Estos comandos son directos y forman la base de una estrategia sólida de SEO técnico.

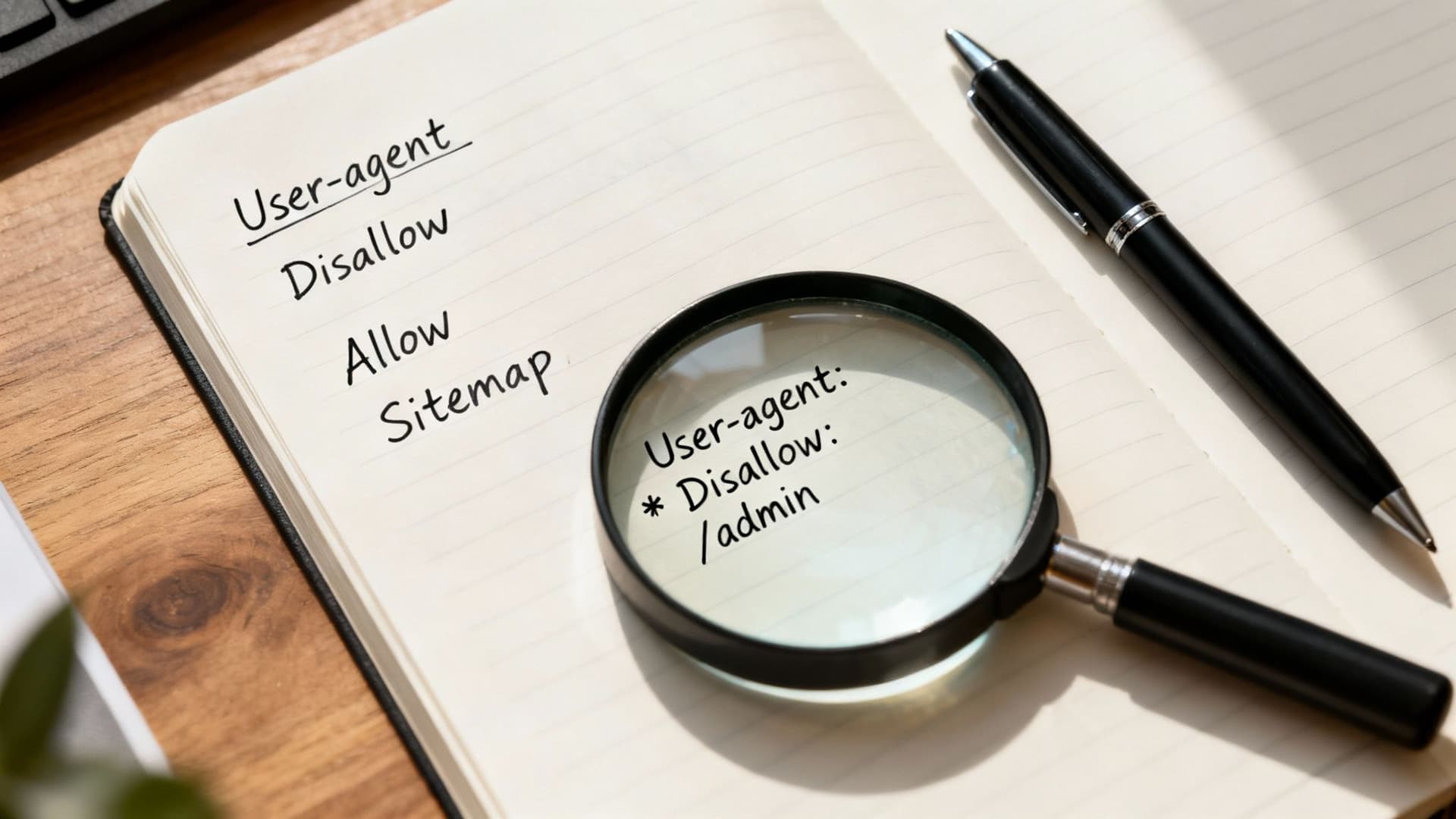

Directivas principales de robots.txt explicadas

| Directiva | Qué hace | Cuándo usarla |

|---|---|---|

| User-agent | Especifica a qué rastreador se aplican las reglas. * es un comodín para todos los bots. | Usa User-agent: * para reglas generales, o especifica Googlebot o Bingbot para instrucciones dirigidas. |

| Disallow | Indica a los bots que no rastreen un archivo o directorio específico. | Bloquea páginas de acceso administrativo (/wp-admin/), resultados de búsqueda internos o páginas de agradecimiento que no aportan. |

| Allow | Anula un Disallow para una subcarpeta o archivo específico. | Permite un único archivo dentro de un directorio denegado. |

| Sitemap | Indica a los rastreadores la ubicación de tu archivo sitemap XML para que puedan descubrir páginas importantes. | Inclúyelo siempre para acelerar el descubrimiento de las páginas que quieres indexar. |

Estos comandos simples te dan un gran control sobre el comportamiento de los rastreadores. Dominarlos te ayuda a crear un archivo robots.txt efectivo.

Poner las directivas en práctica

Si tienes una herramienta interactiva importante—por ejemplo, una calculadora que genera leads—quieres que los motores de búsqueda la rastreen e indexen. Al mismo tiempo, querrás bloquear páginas que no aportan valor SEO. Un robots.txt común y práctico se ve así:

User-agent: *

Disallow: /wp-admin/

Disallow: /private-files/

Disallow: /cgi-bin/

Sitemap: https://yourdomain.com/sitemap.xml

Esta configuración usa User-agent: * para dirigirse a todos los bots, bloquea algunas carpetas no públicas comunes y apunta a los rastreadores al sitemap. Es limpia y eficiente.

Para aprender más sobre cómo se comportan los rastreadores, analiza los registros del servidor y los datos de visitantes. Una vez que entiendas qué bots están visitando tu sitio, puedes crear reglas que apoyen tus objetivos de negocio.

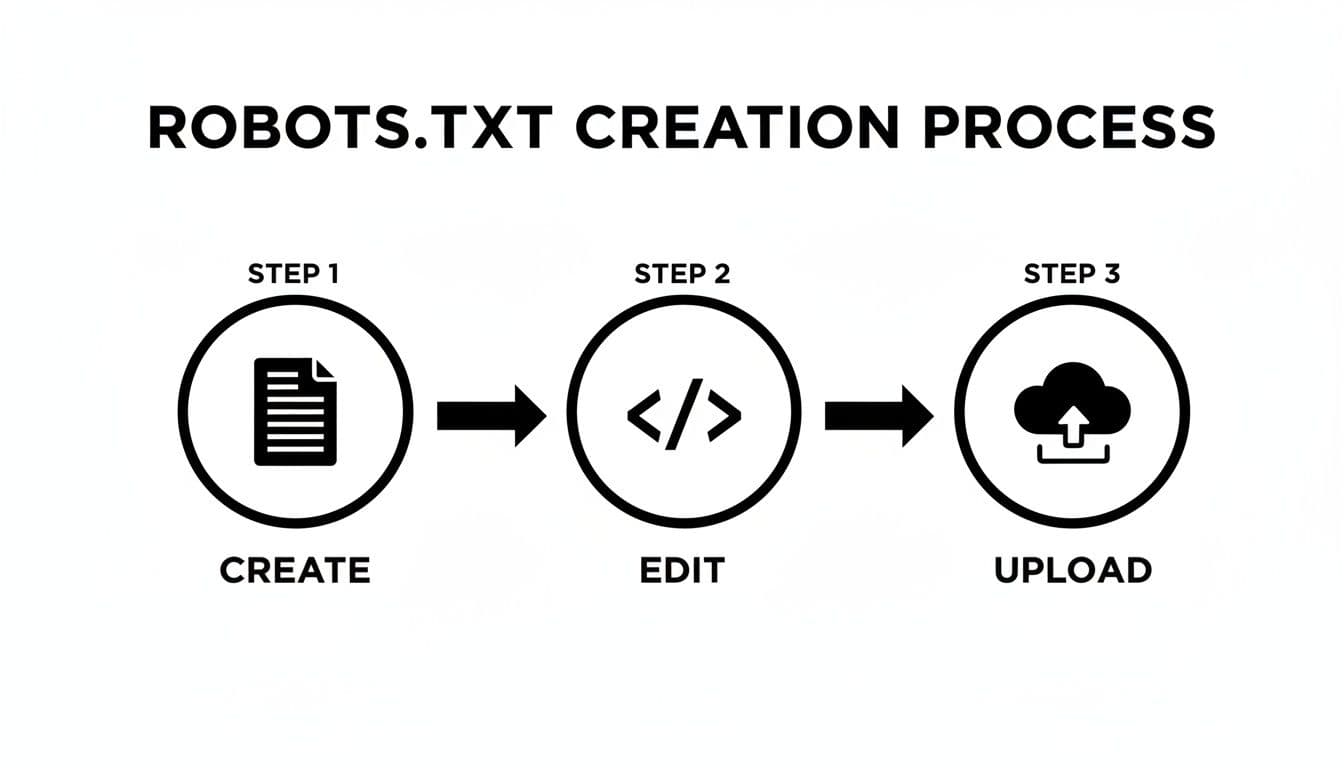

Guía práctica para crear tu archivo robots.txt manualmente

A veces deberías crear el archivo a mano. Usa Notepad o TextEdit, guarda el archivo como texto plano llamado robots.txt (en minúsculas) y súbelo a la raíz de tu sitio vía FTP o el administrador de archivos de tu hosting. Si lo guardas como .docx o .rtf, los rastreadores lo ignorarán.

Colócalo en https://yourdomain.com/robots.txt. Subirlo a una subcarpeta, como /blog/robots.txt, lo hace invisible para los rastreadores.

Crear reglas para objetivos comerciales reales

Ejemplo: un sitio de servicios financieros con una calculadora de hipoteca que genera leads. Quieres que esa herramienta sea indexada, pero no quieres áreas de administración o páginas de agradecimiento en los resultados de búsqueda. Define tus reglas así:

User-agent: *

Allow: /

Disallow: /admin/

Disallow: /thank-you-for-your-submission/

Sitemap: https://www.yourfinancialsite.com/sitemap.xml

Esto indica a todos los rastreadores que pueden rastrear el sitio excepto /admin/ y la página de agradecimiento, y les apunta a un sitemap. Incluye una línea de sitemap como esta para ayudar a los rastreadores a encontrar páginas profundas o importantes más rápido.

Nota: El orden importa en archivos más complejos. Para reglas

AllowyDisallowque se solapan, la regla más específica debe ir primero para Googlebot, o corres el riesgo de bloquear contenido sin querer.

Crear y probar tu robots.txt es un paso central en cualquier auditoría de SEO técnico.

Gestionando la nueva ola de rastreadores de IA y LLM

El panorama de rastreadores ahora incluye bots específicos de IA como GPTBot y Common Crawl. Estos rastreadores han crecido rápidamente, y muchos sitios están ajustando reglas para tratarlos. Los rastreadores de IA educados obedecerán robots.txt, pero los scrapers maliciosos pueden no hacerlo.2

Por qué podrías bloquear rastreadores de IA

Bloquear rastreadores de IA puede proteger contenido original de ser raspado y usado para entrenar modelos sin atribución ni compensación. Si has creado una herramienta en línea única, puede que no quieras que su lógica o datos sean recolectados por terceros. Pondera los beneficios de la visibilidad en plataformas impulsadas por IA contra el riesgo de que tu contenido sea reutilizado.

Analizar los archivos de registro te ayuda a ver qué bots visitan tu sitio e informa si debes bloquearlos.3

Cómo bloquear bots de IA comunes

Añade líneas User-agent específicas para cada rastreador que quieras bloquear. Ejemplos incluyen GPTBot, CCBot, Google-Extended y Anthropic-AI. Para bloquear completamente un bot:

User-agent: GPTBot

Disallow: /

User-agent: CCBot

Disallow: /

User-agent: Google-Extended

Disallow: /

Recuerda, robots.txt es un sistema de honor. Los rastreadores de buena reputación respetarán tus reglas, pero los actores maliciosos pueden ignorarlas. Para una protección más fuerte, considera un Firewall de Aplicación Web (WAF) o una solución dedicada de gestión de bots.

Evitar errores comunes y costosos en robots.txt

Una sola línea mal colocada puede desindexar accidentalmente todo tu sitio. El error clásico es Disallow: /, que indica a todos los rastreadores que no rastreen ninguna página. Si tu sitio desaparece de los resultados de búsqueda de repente, revisa robots.txt primero.

Bloquear archivos esenciales

Bloquear CSS o JavaScript puede impedir que Google renderice las páginas correctamente, lo que perjudica el SEO. Por ejemplo, no bloquees /assets/js/ si tu sitio depende de JavaScript para cargar contenido importante. En su lugar, usa Allow: para esos recursos cuando sea necesario:

- Antes (incorrecto):

Disallow: /assets/js/ - Después (correcto):

Allow: /assets/js/

Reglas en conflicto y errores de sintaxis

Las reglas se leen de arriba hacia abajo, y las reglas más específicas deben ir antes que las más generales. Si quieres bloquear una carpeta /private/ pero permitir un único PDF dentro de ella, coloca la regla Allow primero para Googlebot:

Allow: /private/public-report.pdf

Disallow: /private/

También vigila los errores tipográficos. Una directiva mal escrita como "dissallow" se ignora. Usa la herramienta de prueba de robots.txt de Google Search Console antes de desplegar cambios.

Recuerda, robots.txt es una petición educada, no una garantía. Muchos grandes editores están bloqueando bots de entrenamiento de IA, pero los scrapers determinados pueden ignorar tu archivo por completo.4

Preguntas comunes sobre archivos robots.txt

Robots.txt vs. noindex: ¿cuál es la diferencia?

Robots.txt detiene el rastreo, mientras que una etiqueta noindex impide la indexación. Usa robots.txt para evitar que los rastreadores visiten secciones como páginas de administración; usa noindex en páginas que quieres que sean rastreadas pero no mostradas en resultados de búsqueda, como landing pages temporales.

¿Debería añadir mi sitemap en mi archivo robots.txt?

Sí. Añadir Sitemap: https://www.yourdomain.com/sitemap.xml ayuda a los rastreadores a descubrir e indexar contenido de alto valor y enlaces profundos más rápidamente. Si usas varios sitemaps, añade una línea Sitemap: por cada archivo.

¿Puede robots.txt detener bots maliciosos y scrapers?

Robots.txt ayuda pero no es infalible. Es efectivo contra rastreadores bien comportados, pero los scrapers maliciosos a menudo lo ignoran. Para protección robusta, combina robots.txt con controles a nivel de servidor, un WAF y herramientas de gestión de bots.

¿Listo para aumentar el engagement y el SEO de tu sitio con herramientas interactivas? Con MicroEstimates, puedes crear e incrustar calculadoras personalizadas en tu sitio. Prueba estas herramientas para apoyar la generación de leads y el engagement de usuarios:

Preguntas rápidas — dudas comunes de los lectores

¿Cuál es el robots.txt más sencillo para la mayoría de sitios?

Empieza con:

User-agent: *

Disallow: /wp-admin/

Sitemap: https://yourdomain.com/sitemap.xml

¿Cómo bloqueo GPTBot u otros rastreadores de IA?

Añade una directiva User-agent para cada rastreador y coloca Disallow: / debajo de ella.

¿Cómo pruebo mi robots.txt antes de desplegarlo?

Usa la herramienta de prueba de robots.txt de Google Search Console y revisa los registros del servidor para confirmar el comportamiento que esperas.

¿Listo para construir tus propias herramientas gratis?

Únete a cientos de empresas que ya usan herramientas de estimación personalizadas para aumentar ganancias y conseguir más clientes