Erfahren Sie, wie Sie eine robots.txt-Datei erstellen, um Crawler zu steuern und technisches SEO mit einem praxisnahen, handlungsorientierten Leitfaden zu verbessern.

January 11, 2026 (2mo ago)

SEO meistern: robots.txt-Datei erstellen mit diesem schnellen Leitfaden

Erfahren Sie, wie Sie eine robots.txt-Datei erstellen, um Crawler zu steuern und technisches SEO mit einem praxisnahen, handlungsorientierten Leitfaden zu verbessern.

← Back to blog

Generate robots.txt: Quick SEO Guide

Zusammenfassung: Erfahren Sie, wie Sie eine robots.txt-Datei erstellen und bereitstellen, um Crawler zu steuern, Inhalte zu schützen und das Crawl-Budget mit praktischen Beispielen zu optimieren.

Einleitung

Eine sorgfältig gestaltete robots.txt-Datei gibt Ihnen Kontrolle darüber, welche Crawler auf Ihre Seite zugreifen dürfen, hilft wertvolle Inhalte zu schützen und fokussiert das Crawl-Budget auf die Seiten, die wirklich zählen. Dieser Leitfaden zeigt klare, praxisnahe Schritte zum Erstellen, Testen und Aktualisieren Ihrer robots.txt, damit Suchmaschinen und höfliche Bots sich so verhalten, wie Sie es möchten.

Zum Einstieg

Erstellen Sie eine Textdatei mit dem Namen robots.txt, fügen Sie Direktiven wie User-agent: und Disallow: hinzu und laden Sie sie ins Stammverzeichnis Ihrer Seite unter https://yourdomain.com/robots.txt hoch. Diese einzelne Datei fungiert als einfache Anweisungssammlung für Suchmaschinen-Crawler und andere Bots.

Warum Ihre robots.txt-Datei ein kritisches SEO-Tool ist

Mit robots.txt zu arbeiten kann technisch wirken, aber sie ist der Türsteher Ihrer Website. Richtig eingesetzt, spart sie Serverressourcen und lenkt Crawler zu hochwertigen Seiten — was Indexierung und Rankings verbessert. Das Robots Exclusion Protocol reicht bis zu den Anfängen des Webs zurück, und seine Rolle hat sich zu einem zentralen Bestandteil der Website-Infrastruktur entwickelt.1

Eine fokussierte robots.txt hilft Ihnen, Crawler zu den Seiten zu lenken, die Traffic, Leads und Umsatz bringen, und sie fernzuhalten von Bereichen, die das Crawl-Budget vergeuden, wie Admin-Seiten, interne Suchergebnisse und doppelte druckerfreundliche Seitenversionen.

Eine robots.txt-Datei ist mehr als eine Ausschlussliste; sie ist ein strategischer Leitfaden für Suchmaschinen. Sie sagt ihnen, wo sie ihre begrenzte Zeit auf Ihrer Seite verbringen sollen, und beeinflusst damit direkt, welche Seiten indexiert und gerankt werden.

Letztendlich bedeutet eine korrekte robots.txt besseres SEO, geschonte Serverressourcen und eine klarere Auffindbarkeit Ihrer wertvollsten Inhalte.

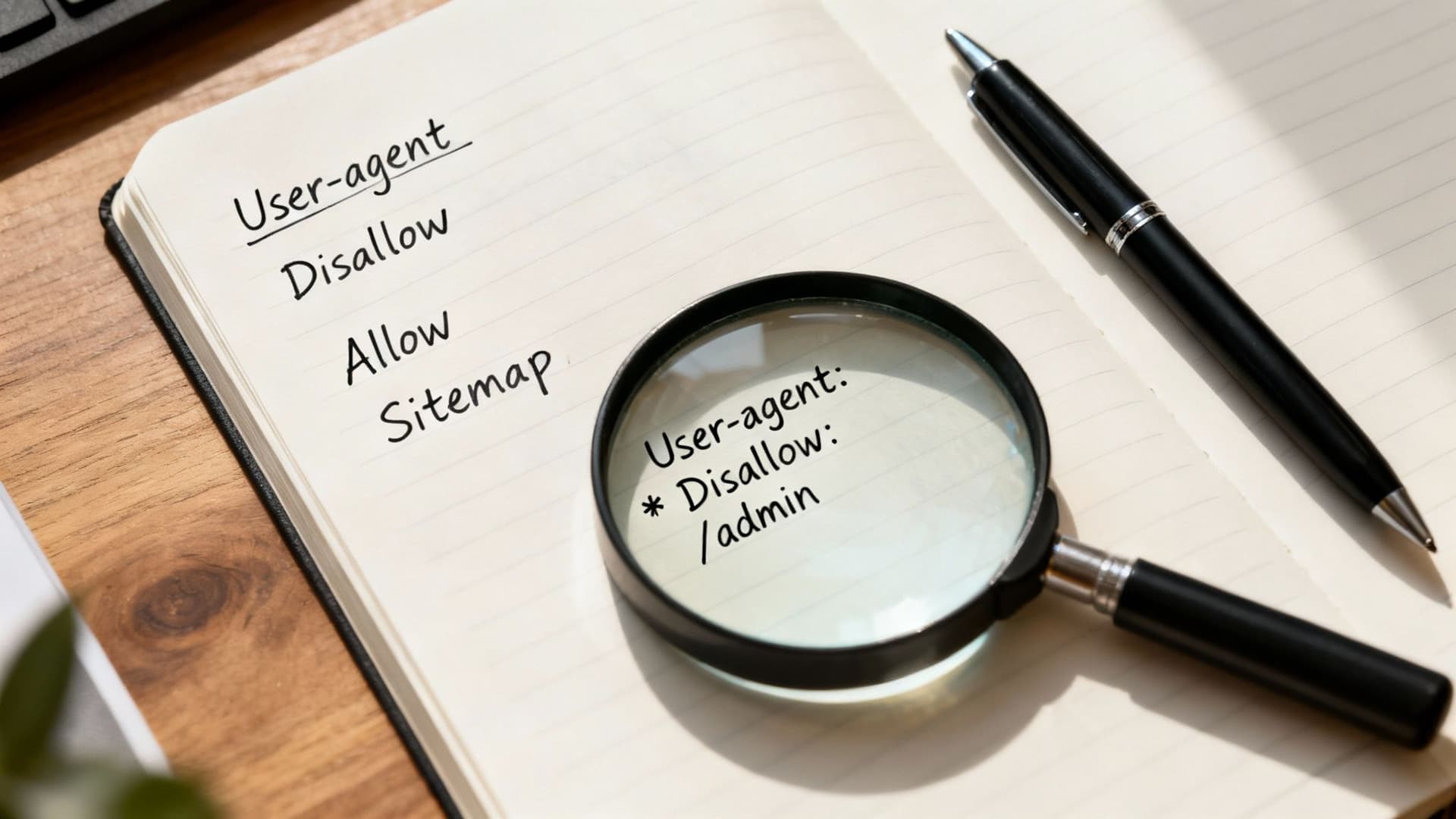

Die Sprache der Web-Crawler verstehen

Robots.txt ist ein kurzes Gespräch mit Crawlern. Die Datei verwendet einfache Direktiven, um anzuzeigen, welche Türen offen oder geschlossen sind. Diese Befehle sind leicht verständlich und bilden die Grundlage einer soliden technischen-SEO-Strategie.

Wichtige robots.txt-Direktiven erklärt

| Directive | What it does | When to use it |

|---|---|---|

| User-agent | Specifies which crawler the rules apply to. * is a wildcard for all bots. | Use User-agent: * for general rules, or specify Googlebot or Bingbot for targeted instructions. |

| Disallow | Tells bots not to crawl a specific file or directory. | Block admin login pages (/wp-admin/), internal search results, or unhelpful thank-you pages. |

| Allow | Overrides a Disallow for a specific subfolder or file. | Allow a single file inside a disallowed directory. |

| Sitemap | Points crawlers to your sitemap XML file so they can discover important pages. | Always include this to speed discovery of pages you want indexed. |

Diese einfachen Befehle geben Ihnen starke Kontrolle über das Verhalten von Crawlern. Sie zu beherrschen hilft Ihnen, eine effektive robots.txt-Datei zu erstellen.

Direktiven in der Praxis anwenden

Wenn Sie ein wichtiges interaktives Tool haben — zum Beispiel einen lead-generierenden Rechner — möchten Sie, dass Suchmaschinen es crawlen und indexieren. Gleichzeitig sollten Sie Seiten blockieren, die keinen SEO-Wert bringen. Eine übliche, praxisnahe robots.txt sieht so aus:

User-agent: *

Disallow: /wp-admin/

Disallow: /private-files/

Disallow: /cgi-bin/

Sitemap: https://yourdomain.com/sitemap.xml

Diese Konfiguration nutzt User-agent: *, um alle Bots anzusprechen, blockiert einige gängige nicht-öffentliche Ordner und verweist Crawler auf die Sitemap. Sie ist sauber und effizient.

Um mehr über das Verhalten von Crawlern zu erfahren, analysieren Sie Server-Logs und Besucherdaten. Sobald Sie verstehen, welche Bots Ihre Seite besuchen, können Sie Regeln erstellen, die Ihre Geschäftsziele unterstützen.

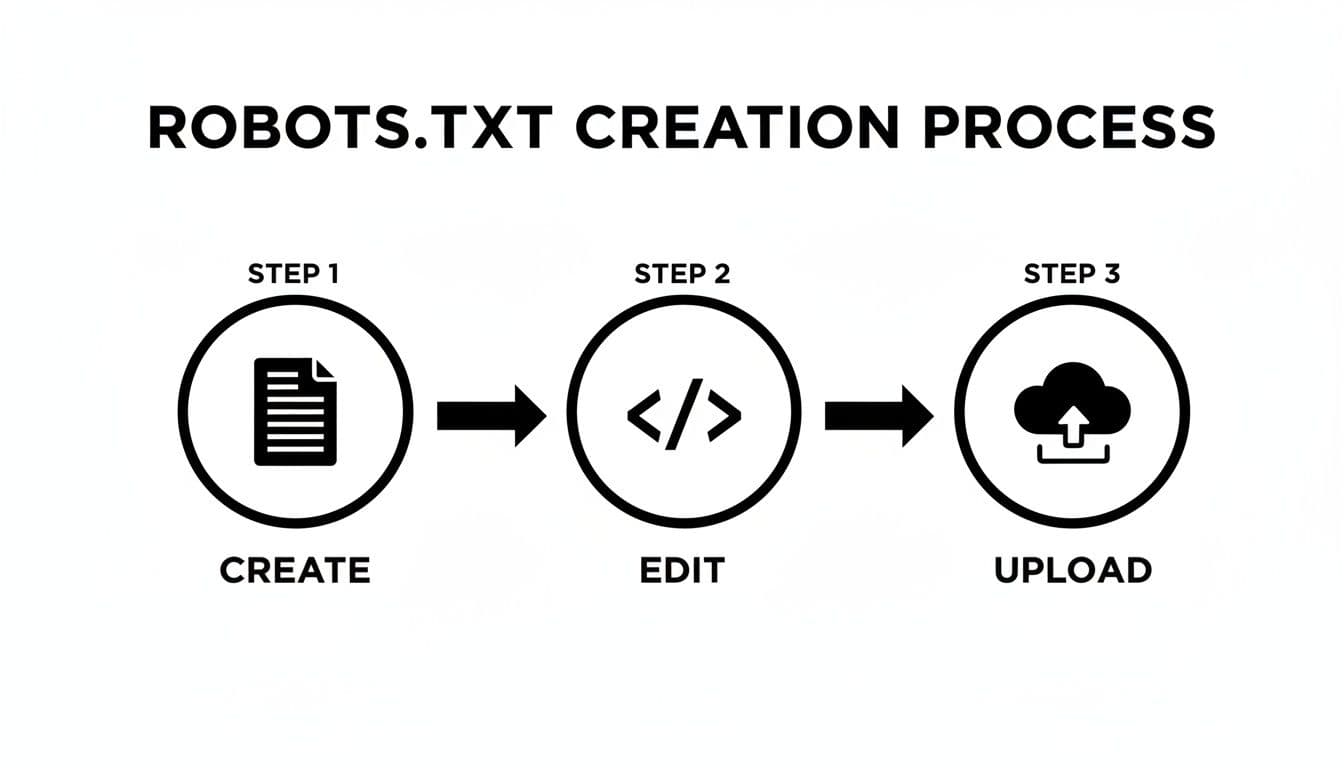

Praktische Anleitung: robots.txt-Datei manuell erstellen

Manchmal sollten Sie die Datei von Hand erstellen. Verwenden Sie Notepad oder TextEdit, speichern Sie die Datei als reinen Text mit dem Namen robots.txt (kleingeschrieben) und laden Sie sie per FTP oder über den Datei-Manager Ihres Hosts ins Website-Root hoch. Wenn Sie sie als .docx oder .rtf speichern, wird sie von Crawlern ignoriert.

Platzieren Sie sie unter https://yourdomain.com/robots.txt. Wenn Sie sie in einen Unterordner hochladen, z. B. /blog/robots.txt, ist sie für Crawler unsichtbar.

Regeln für reale Geschäftsziele formulieren

Beispiel: Eine Finanzdienstleistungsseite mit einem lead-generierenden Hypothekenrechner. Sie möchten, dass dieses Tool indexiert wird, aber Admin-Bereiche oder Danke-Seiten nicht in den Suchergebnissen erscheinen. Setzen Sie Ihre Regeln so:

User-agent: *

Allow: /

Disallow: /admin/

Disallow: /thank-you-for-your-submission/

Sitemap: https://www.yourfinancialsite.com/sitemap.xml

Das sagt allen Crawlern, dass sie die Seite crawlen dürfen, außer /admin/ und der Danke-Seite, und verweist sie auf eine Sitemap. Fügen Sie eine Sitemap-Zeile wie diese hinzu, um Crawler dabei zu helfen, tiefer liegende oder wichtige Seiten schneller zu finden.

Hinweis: Die Reihenfolge ist in komplexeren Dateien wichtig. Bei sich überschneidenden

Allow- undDisallow-Regeln sollte die spezifischste Regel für Googlebot zuerst stehen, sonst riskieren Sie, Inhalte unbeabsichtigt zu blockieren.

Das Erstellen und Testen Ihrer robots.txt ist ein zentraler Schritt in jedem technischen-SEO-Audit.

Umgang mit der neuen Welle von KI- und LLM-Crawlern

Die Crawler-Landschaft umfasst mittlerweile KI-spezifische Bots wie GPTBot und Common Crawl. Diese Crawler sind schnell gewachsen, und viele Websites passen ihre Regeln an, um auf sie zu reagieren. Höfliche KI-Crawler werden sich an robots.txt halten, aber bösartige Scraper möglicherweise nicht.2

Warum Sie KI-Crawler blockieren könnten

Das Blockieren von KI-Crawlern kann originelle Inhalte davor schützen, abgeschöpft und zum Modelltraining ohne Zuschreibung oder Vergütung verwendet zu werden. Wenn Sie ein einzigartiges Online-Tool entwickelt haben, möchten Sie möglicherweise nicht, dass dessen Logik oder Daten von Dritten erfasst werden. Wiegen Sie die Vorteile der Sichtbarkeit auf KI-gesteuerten Plattformen gegen das Risiko ab, dass Ihre Inhalte wiederverwendet werden.

Die Analyse von Log-Dateien hilft Ihnen zu sehen, welche Bots Ihre Seite besuchen, und informiert darüber, ob Sie sie blockieren sollten.3

Wie man gängige KI-Bots blockiert

Fügen Sie spezifische User-agent-Zeilen für jeden Crawler hinzu, den Sie blockieren möchten. Beispiele sind GPTBot, CCBot, Google-Extended und Anthropic-AI. Um einen Bot vollständig zu blockieren:

User-agent: GPTBot

Disallow: /

User-agent: CCBot

Disallow: /

User-agent: Google-Extended

Disallow: /

Denken Sie daran: robots.txt ist ein Ehrensystem. Seriöse Crawler respektieren Ihre Regeln, aber böswillige Akteure können sie ignorieren. Für stärkeren Schutz sollten Sie eine Web Application Firewall (WAF) oder eine dedizierte Bot-Management-Lösung in Betracht ziehen.

Häufige und kostspielige robots.txt-Fehler vermeiden

Eine einzelne falsch platzierte Zeile kann Ihre gesamte Seite unbeabsichtigt de-indexieren. Der klassische Fehler ist Disallow: /, was allen Crawlern sagt, keine Seiten zu crawlen. Wenn Ihre Seite plötzlich aus den Suchergebnissen verschwindet, prüfen Sie zuerst die robots.txt.

Essentielle Dateien blockieren

Das Blockieren von CSS oder JavaScript kann verhindern, dass Google Seiten korrekt rendert, was dem SEO schadet. Blockieren Sie zum Beispiel nicht /assets/js/, wenn Ihre Seite auf JavaScript angewiesen ist, um wichtige Inhalte zu laden. Verwenden Sie stattdessen bei Bedarf Allow: für diese Ressourcen:

- Vorher (falsch):

Disallow: /assets/js/ - Nachher (richtig):

Allow: /assets/js/

Konfliktierende Regeln und Syntaxfehler

Regeln werden von oben nach unten gelesen, und spezifischere Regeln sollten vor allgemeineren stehen. Wenn Sie einen /private/-Ordner blockieren, aber eine einzelne PDF darin erlauben wollen, setzen Sie die Allow-Regel zuerst für Googlebot:

Allow: /private/public-report.pdf

Disallow: /private/

Achten Sie auch auf Tippfehler. Eine falsch geschriebene Direktive wie "dissallow" wird ignoriert. Verwenden Sie das robots.txt-Tester-Tool der Google Search Console, bevor Sie Änderungen einführen.

Denken Sie daran: robots.txt ist eine höfliche Aufforderung, keine Garantie. Viele große Publisher blockieren KI-Trainings-Bots, aber entschlossene Scraper können Ihre Datei völlig ignorieren.4

Häufige Fragen zu robots.txt-Dateien

Robots.txt vs. noindex: Was ist der Unterschied?

Robots.txt verhindert das Crawlen, während ein noindex-Tag die Indexierung stoppt. Verwenden Sie robots.txt, um Crawler daran zu hindern, Bereiche wie Admin-Seiten zu besuchen; verwenden Sie noindex auf Seiten, die gecrawlt, aber nicht in den Suchergebnissen angezeigt werden sollen, z. B. temporäre Landingpages.

Sollte ich meine Sitemap in die robots.txt-Datei aufnehmen?

Ja. Das Hinzufügen von Sitemap: https://www.yourdomain.com/sitemap.xml hilft Crawlern, tief verlinkte, wertvolle Inhalte schneller zu entdecken und zu indexieren. Wenn Sie mehrere Sitemaps verwenden, fügen Sie für jede Datei eine Sitemap:-Zeile hinzu.

Kann robots.txt bösartige Bots und Scraper stoppen?

Robots.txt hilft, ist aber nicht narrensicher. Sie ist gegen wohlverhaltende Crawler wirksam, aber böswillige Scraper ignorieren sie oft. Für robusten Schutz kombinieren Sie robots.txt mit serverseitigen Kontrollen, einer WAF und Bot-Management-Tools.

Bereit, das Engagement und SEO Ihrer Seite mit interaktiven Tools zu steigern? Mit MicroEstimates können Sie benutzerdefinierte Rechner erstellen und in Ihre Seite einbetten. Probieren Sie diese Tools aus, um Lead-Generierung und Nutzerengagement zu unterstützen:

Kurzes Q&A — häufige Leserfragen

Was ist die einfachste robots.txt für die meisten Sites?

Beginnen Sie mit:

User-agent: *

Disallow: /wp-admin/

Sitemap: https://yourdomain.com/sitemap.xml

Wie blockiere ich GPTBot oder andere KI-Crawler?

Fügen Sie für jeden Crawler eine User-agent-Direktive hinzu und setzen Sie darunter Disallow: /.

Wie teste ich meine robots.txt vor der Bereitstellung?

Verwenden Sie den robots.txt-Tester der Google Search Console und prüfen Sie Server-Logs, um das erwartete Verhalten zu bestätigen.

Bereit, Ihre Eigenen Tools kostenlos zu erstellen?

Schließen Sie sich Hunderten von Unternehmen an, die bereits benutzerdefinierte Schätztools verwenden, um Gewinne zu steigern und mehr Kunden zu gewinnen